看个很适合开发者停止自我折磨的消息。

OpenAI 的奥特曼发了个推。

月球地平线上升起一个发光的卡片,写着“Message ChatGPT”。

带上奥特曼的配文“Call me maybe”,下面的评论各种猜测。

说什么 OpenAI 要做手机之类的。

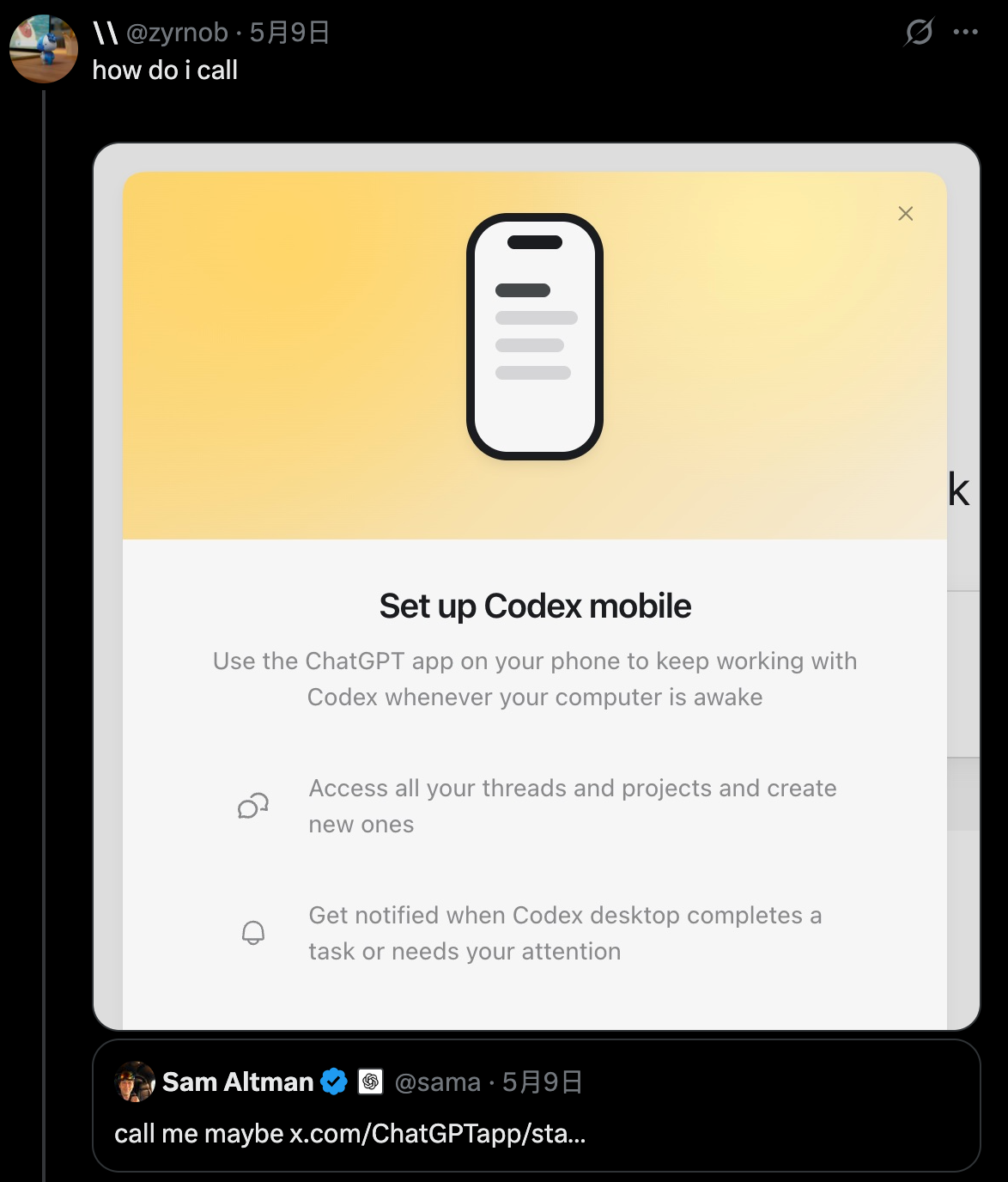

但配上另一个 ChatGPT 截图评论。

我们就不用猜了。

这个叫@zymob的用户在 ChatGPT App 里扒出一个隐藏界面,叫 Set up Codex mobile。

下面那行解释很关键:

只要你的电脑醒着,就可以在手机上继续和 Codex 一起干活。

这句话如果给普通用户看,可能就是:

哦,手机也能看 Codex 了。

但如果你过去半年折腾过 OpenClaw、Hermes、TUI、消息网关、浏览器操控这些东西,你看到这句话的反应应该是:

哥们,终于要把这坨赛博插线板收起来了是吧?

ChatGPT 移动端可能要打通 Codex App 桌面端。

如果这事儿跑顺,它解决的不是一个小功能。

它解决的是过去半年 AI Agent 远程协作里最烦人的一件事:

第三方工具能远程,但贵。

官方工具又强又省,但不够远程。

现在 OpenAI 可能要把这两边接起来。

远程养龙虾早就有了,但 token 烧不起

市场上早就有 OpenClaw、Hermes 这类东西。

它们本质上是一个带 message channel gateway 的 agent 应用。

Telegram、网页、桌面、服务器、浏览器、终端、各种模型,全都可以往里接。

你人在外面发个消息,VPS 上的 agent 收到任务,跑命令,改代码,回结果。

听起来很美。

实际上也确实能用。

我自己也用过。

但它有一个很朴素的问题:

贵。

不是软件贵。

是 token 贵。

OpenClaw/Hermes 这种多功能 agent,为了支持多模型、多渠道、会话记录、工具调用、远程协作,会带很多上下文和管理开销。

它像一个什么都能干的瑞士军刀。

问题是你只是想开个罐头,它先给你展开十七个刀头,再给你写一篇开罐方法论。

每次对话都不是只在干活。

它还要记历史。

还要管通道。

还要兼容模型。

还要维持工具状态。

还要把自己当成一个小型操作系统。

最后账单一来,你发现代码还没写多少,token 已经开始修仙。

Codex CLI 省钱,但它更像码农

所以我现在的远程方案,是 OpenClaw + Codex CLI 跑在 VPS 上。

OpenClaw 负责远程通信。

Codex CLI 负责真正干开发活。

别问我为什么不用 Claude Code,gpt-5.5 爆杀 opus 好不好!

这比纯 OpenClaw 直接接 API 省很多 token。

原因也很简单。

它就是冲着代码任务来的。

没有那么多花里胡哨的功能占用上下文。

这就像你找人修水管。

一个是全能管家,进门先问你家庭成员结构、人生规划和装修风格。

一个是水管工,进门先看漏点。

但 Codex CLI 的问题是,它毕竟还是 CLI。

它很适合开发。

但不太适合处理桌面端那种更宽的工作流。

比如浏览器操作。

比如桌面应用。

比如需要你本地环境和视觉上下文的任务。

这时候 Codex App 就开始有意思了。

Codex App 不只是写代码,但缺远程控制

Codex App 桌面端现在真正让我感兴趣的,不只是它能改代码。

而是它开始有 computer use、Chrome use 这些能力。

当然 Claude Cowork 早就有了,但在国内用不了啊。

用着会被封号啊。

哪像 OpenAI 搭上梯子随便用。

问题来了。

Codex App 很强。

但它不像 Codex CLI 那样容易被 OpenClaw/Hermes 当后端接进去。

CLI 天生适合远程。

命令一跑,日志一回,完事。

App 不一样。

App 是桌面端,它不好被第三方 gateway 接管。

于是就出现一个很尴尬的局面:

OpenClaw/Hermes 能远程协作,但 token 消耗大。

Codex CLI 省 token,但主要还是开发场景。

Codex App 能做更多桌面工作,但不支持远程操作。

你说气不气。

这是 Codex App + 官方网关

这次曝光的 Codex mobile,如果真的打通 ChatGPT 移动端和 Codex App 桌面端,那就等于 OpenAI 自己给 Codex App 做了一个官方 message channel gateway。

OpenClaw 像是在桌子下面接插线板。

一个转接头接 Telegram。

一个转接头接模型 API。

一个转接头接浏览器。

一个转接头接 CLI。

一个转接头接会话数据库。

最后插线板热得像过年烤红薯。

官方如果自己把手机端和桌面端接起来,那才是正经插座。

这可能是远程 AI 协作的最优解。

我为什么关心这个?

因为我现在真的在用这些东西。

不是看热闹。

我用过 OpenClaw/Hermes 这种 gateway agent。

也用 Codex CLI 在 VPS 上远程协作。

现在又在用 Codex App 做桌面端工作。

这个问题非常现实:

我出门以后,能不能继续让家里 MacBook 上的 Codex App 干活?

我能不能在手机上派任务?

人在外面。

MacBook 在家里。

Codex App 坐在桌面前。

GPT-5.5 在后面干活。

你只负责在关键节点看看手机,说一句:

可以,继续。

然后继续逛街。